Transformer les systèmes critiques avec l’IA de confiance

La journée qui s’est déroulée ce jeudi 7 mars 2024 a donné l’occasion aux membres fondateurs de l’initiative de Confiance.ai de présenter les fruits du travail mené lors de ces trois dernières années dont le fleuron est « une méthodologie outillée » pour le design de l’IA industrielle.

Cette annonce marque ainsi un jalon important dans l’ambition de la France de devenir un des pays leaders de l’IA industrielle, pérenne et responsable. En effet, comme l’a expliqué Juliette Mattioli, présidente du comité de pilotage du programme et experte en IA chez Thales, beaucoup de sociétés industrielles ont travaillé sur des PoC autour de l’IA. Cependant, le passage à l’échelle sur des infrastructures critiques s’est avéré compliqué en raison de nombreux enjeux majeurs à prendre en compte, y compris la nécessité d’assurer une haute fiabilité des résultats.

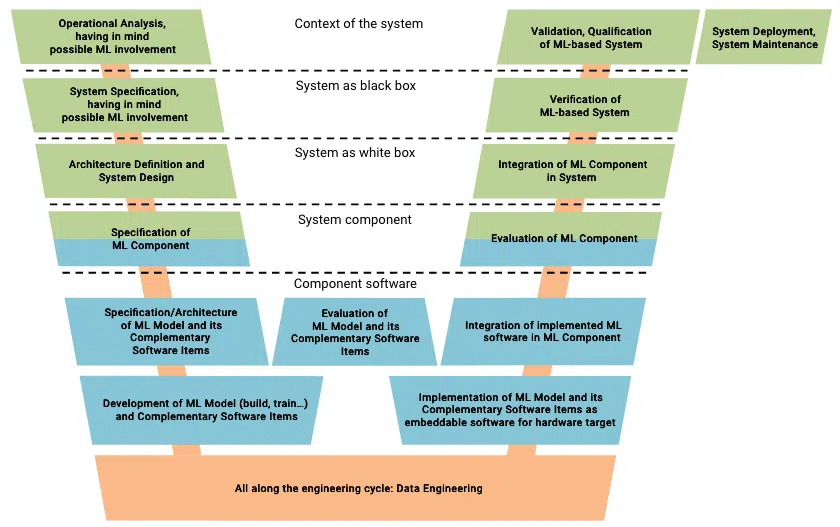

Cette méthodologie, conçue comme un guide de bout en bout offre donc la possibilité de caractériser et d’évaluer la fiabilité d’un système intelligent basé sur les données, et de l’incorporer dans les produits et services industriels. Selon ses concepteurs, elle est universelle et peut être appliquée dans n’importe quel domaine industriel. La méthodologie et son catalogue d’outils, composée de solutions propriétaires et open sources, est en accès libre. Le stack des outils est évolutif et sera enrichi à fur et à mesure des avancements dans le domaine. Les composants ont été regroupés en neuf ensembles fonctionnels correspondant à des processus d’ingénierie bien précis, allant de l’ingénierie de bout en bout et la gestion du cycle de vie de la donnée, des modèles et des composants, à leur évaluation (robustesse, explicabilité, etc).

Systems Engineering and Software Engineering lifecycle

Source : Activities for the engineering of a critical ML-based system (bok.confiance.ai)

Cette initiative constitue une brique importante dans l’harmonisation des approches envers le design de l’IA industrielle. Elle devrait permettre aux industriels de mieux se préparer pour le futur « AI Act », dont les exigences se concentrent principalement sur les systèmes à haut risque et à risque systémique, en apportant des outils pour sa mise en œuvre opérationnelle.

De façon générale, Confiance.ai se voit aussi en tant que moteur du développement de l’écosystème mondial de l’IA de confiance. Les leviers principaux sont l’enrichissement de son écosystème, aujourd’hui composé de près d’une cinquantaine de partenaires (laboratoires et instituts de recherche, startups, et grands groupes), et le développement des collaborations avec ses homologues à l’international, comme celles avec le Canada, l’Allemagne, et l’Australie.

Bien que les résultats obtenus soient concluants et correspondent aux attentes, Fabien Mangeant, président du comité de direction de Confiance.ai et directeur scientifique Digital d’Air Liquide a souligné qu’“il reste encore de nombreux défis scientifiques et technologiques à relever pour que la France maintienne son avance dans le domaine ». Alors que leurs travaux s’achèveront fin 2024, les partenaires du programme réfléchissent sur le sujet de l’après Confiance.ai. Leurs ambitions s’articulent autour de trois axes :

- Approfondir, e.g. en étendant le périmètre sur IA hybride, IA générative, cybersécurité des IA intégrées aux systèmes critiques, etc ;

- Pérenniser, y compris à travers le lancement d’une initiative de fondation pour fédérer un ensemble d’acteurs à l’échelle internationale autour d’une feuille de route commune ;

- Et industrialiser les résultats du programme pour aider les industriels à monter en maturité et rendre l’IA utilisable à grande échelle, y compris en mettant en place des outils tenant compte des spécificités propres à chaque entreprise en matière de typologie de données et de cas d’usage.

En guise de conclusion, les industriels et les ESN ont désormais un fils rouge officiel pour faciliter leurs démarches du design de l’IA industriel.